Amazon Vulcan, une révolution tactile dans la robotique

Le robot logistique de la firme, Vulcan, représente un bond en avant important pour la robotique, avec un équipement capable de « sentir » ce qu’il touche.

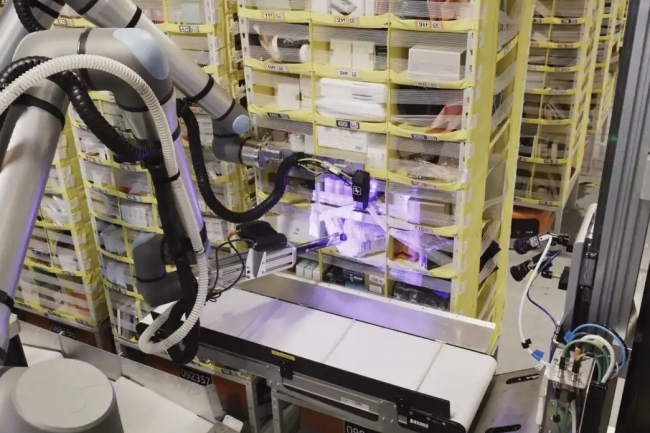

Dans un contexte d’automatisation croissante des entrepôts, Amazon a dévoilé Vulcan, un robot armé de deux bras déjà mis en service dans les entrepôts de Spokane (État de Washington) et de Hambourg (Allemagne), où il a traité plus d’un demi-million de commandes. Conçu par Aaron Parness, ingénieur en robotique, et son équipe de 250 personnes chez Amazon, Vulcan a été présenté au monde le 7 mai lors de l’événement « Delivering the Future » (« Livrer l’avenir ») à Dortmund. Le sens du toucher de Vulcan provient plus précisément de ses pinces sensibles à la force et des capteurs situés sur ses articulations, qui fournissent à son intelligence artificielle des données sur les arêtes, les contours, et la résistance des objets qu’il saisit ou déplace. Grâce à cette faculté, Vulcan saisit ainsi délicatement un sachet souple de bonbons sans l’écraser, ou manipule un livre épais avec plus de fermeté sans le faire chuter.

L’un des bénéfices d’un robot capable de détecter ce qu’il saisit est sa flexibilité, rendant possible la manipulation d’une plus large gamme de produits. Selon Amazon, Vulcan peut traiter environ 75 % du million d’articles présents dans un entrepôt type de l’entreprise.

Sentiments partagés face aux robots tactiles

Vulcan est le premier robot d’Amazon doté, selon la firme, « d’un véritable sens du toucher », grâce aux capteurs de retour de force. S’ajoutant à un logiciel piloté par l’IA, cette configuration lui permet alors de « sentir » les objets, et non simplement de les voir (les caméras sont les principaux capteurs de la plupart des robots d’Amazon). Si vous êtes familiers des vues d’anthropomorphisation (humanisation) des robots et IA, vous aurez peut-être deviné ce que nous nous apprêtons à dire. Amazon explique que Vulcan peut ressentir (sans guillemets), et cette affirmation est fausse. Lorsqu’un robot comme Vulcan « ressent » quelque chose, il mobilise des récepteurs qui mesurent la force, la pression, et parfois la texture ou la forme, transformant ces signaux en donnée que l’IA peut interpréter. De plus, les capteurs sensoriels de Vulcan sont intégrés à ses pinces et ses articulations. Cela lui permet, lorsqu’il touche ou saisit un objet, de détecter la force qu’il exerce et les contours qu’il rencontre. Les algorithmes de machine learning aident ainsi Vulcan à choisir comment ajuster ses pinces ou ses mouvements basés sur ce retour sensoriel.

A l’inverse, un être humain peut sentir grâce à un réseau de millions de terminaisons nerveuses situées dans la peau, particulièrement au bout des doigts. Ces nerfs envoient des informations détaillées et en temps réel au cerveau sur la pression, la température, la texture, la douleur, et même la direction de la force. Le sens du toucher humain est en outre profondément lié à la mémoire, aux émotions, aux jugements, et à la conscience. Ainsi, un robot tel que Vulcan peut égaler voire surpasser l’humain dans la détection de la pression ou l’identification des textures, mais cette « sensation » est exclusivement mécanique et numérique. Ils n’ont pas de sensation ou d’émotion, et ils perçoivent seulement ce que leurs capteurs sont capables de mesurer, et ce que leurs logiciels pourront interpréter. Les êtres humains, au contraire, ressentent d’une manière physique, émotionnelle, et consciente. Cette mise en garde étant faite, il faut à présent expliquer à quel point Vulcan est une avancée.

Faciliter le travail des opérateurs d’entrepôt

Selon Aaron Parness, les capacités sensorielles du toucher de Vulcan constituent une avancée importante car il apporte « une intelligence physique » aux robots. Les principaux progrès que connaîtront les robots au cours des prochaines décennies concerneront, en effet, l’amélioration de ces capteurs. Ils seront de plus en plus à même de détecter et de s’adapter aux conditions réelles du monde physique, tout en étant entraînés dans des environnements IA physique virtuelle. Malgré l’état avancé de la technologie Vulcan, son objectif principal reste cependant limité : l’extraction d’articles du stockage en vrac afin de les ranger dans des étagères mobiles, une tâche auparavant réalisée par l’humain.

Vulcan n’est ni un robot humanoïde, ni doté d’une main inspirée de l’anatomie humaine : modéliser les robots d’usine sur des parties du corps humain n’a en effet aucun sens. La « main » de Vulcan combine une pince à tapis roulant et un outil en forme de spatule, tous deux équipés de capteurs mesurant en permanence la pression et la force de rotation. S’ajoute à cela, un outil semblable à une règle, fixé entre les deux palettes, qui sert de guide spatial : il pousse légèrement les objets déjà présents dans les bacs de stockage pour faire de la place à ceux que le robot insère. L’IA du robot, entraînée sur des milliers d’heures d’interactions physiques, calcule en temps réel la force exacte à appliquer sur chaque objet. Vulcan peut alors fonctionner jusqu’à 20 heures par jour sans pause-café ni passage aux toilettes, à une vitesse comparable à celle d’un opérateur humain. Mais le robot reste en permanence derrière une barrière de sécurité, au cas où il devenait incontrôlable. Dans un même temps, le robot Vulcan a de vraies limites. Par exemple, il est trop faible pour soulever des objets de plus de 3,6 kg, et il ne fait que déplacer des produits d’un point A à un point B. S’il rencontre un article inconnu ou un objet dépassant cette limite de poids, il demande l’intervention d’un opérateur humain.

Le rôle essentiel des robots tactiles

Vulcan n’est pas le seul robot doté d’un sens du toucher. Les capteurs RoboTact et RoboTouch, développés au fil de plusieurs décennies et aujourd’hui utilisés aussi bien dans les robots humanoïdes que dans les robots de service, permettent aux machines de percevoir le contact, la pression, et même la forme des objets. Ces capacités leur permettent alors une manipulation à la fois délicate et précise. L’entreprise canadienne Sanctuary AI a équipé son robot Phoenix de capteurs tactiles lui permettant d’effectuer des tâches complexes en reposant fortement sur le toucher. Grâce à cette technologie, Phoenix peut détecter des phénomènes tel que le glissement d’un objet ou une pression excessive, même lorsqu’il ne voit pas ce qu’il est en train de faire. De son côté, Meta a mis au point le capteur Digit 360, un dispositif en forme de bout de doigt capable de détecter des forces aussi faibles qu’un millinewton et de percevoir des détails jusqu’à sept microns. Bien que ce capteur soit encore en phase de développement en laboratoire, le partenariat de Meta avec GelSight et Wonik Robotics vise à le faire entrer progressivement dans des usages réels.

À terme, les robots dotés d’un véritable sens du toucher pourraient révolutionner la robotique, en leur permettant d’accomplir des tâches encore impossibles à ce jour : cueillir des fraises, pratiquer des opérations chirurgicales, ou encore désamorcer des bombes. Mais pour l’instant, Amazon utilise certains des robots tactiles les plus avancés au monde… pour expédier des peignoirs, des livres et des piles à ses clients.