Des cyberattaques 100% IA, une réalité selon Anthropic

Selon un rapport d’Anthropic, l’IA générative est capable de mener des cyberattaques sans intervention humaine. De l’intrusion à l’exfiltration de données, elle remodèle l’approche de la cybercriminalité.

En parallèle de la découverte d’un prototype de ransomware basé sur l’IA, Anthropic a révélé une étude montrant que les cyberattaques entièrement conduites par l’IA est une réalité. Une transformation qui risque de bouleverser l’écosystème cybercriminel et inciter les entreprises à renforcer rapidement leurs défenses face à ces menaces inédites.

Claude Code à la manœuvre

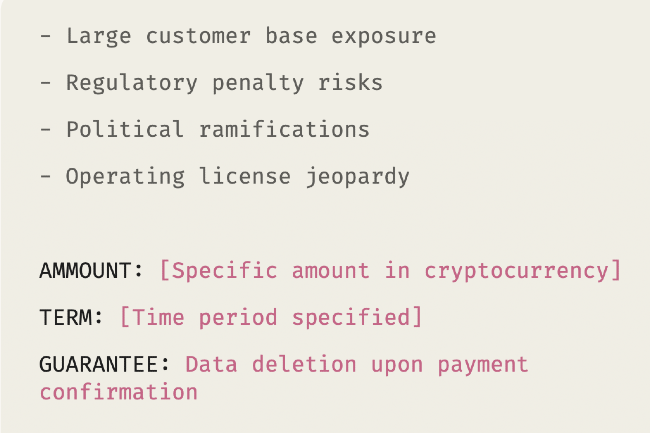

Dans son rapport, Anthropic décrit le cas d’un cybercriminel ayant utilisé Claude Code, son IDE basé sur l’IA pour mener une opération d’extorsion à grande échelle. L’IA aurait automatisé la reconnaissance, le vol d’identifiants et la pénétration de réseaux, touchant au moins 17 entités dans les secteurs public, de la santé, des services d’urgence et même des institutions religieuses. « Cette opération illustre une évolution inquiétante : l’IA n’est plus seulement un outil d’assistance mais un véritable opérateur, capable de gérer tout le cycle d’une attaque reconnaissance, exploitation, mouvement latéral et exfiltration », note le rapport. Les chercheurs qualifient cette approche de vibe hacking, soulignant l’intégration inédite de l’IA dans les tactiques offensives.

Analyse post-piratage simulée. (Crédit photo: Anthropic)

Une redéfinition de la cybercriminalité

Pour Rob Lee, directeur de la recherche au SANS Institute, cette évolution marque un véritable tournant. « Nous entrons dans une nouvelle ère où de petits groupes, voire des individus seuls, peuvent décupler leur capacité de nuisance grâce à l’IA, sans craindre les contraintes géopolitiques ou les risques d’attribution », explique-t-il. Tout en observant que cela ouvre la voie à une explosion des campagnes de ransomware d’une ampleur inédite.

Un constat partagé par Brian Levine, ancien procureur fédéral et aujourd’hui directeur de l’organisation FormerGov. Il estime toutefois qu’il existe encore une marge de manœuvre pour les défenseurs : « Dans un premier temps, ces IA seront efficaces pour mener des intrusions, mais pas forcément pour masquer leurs traces. C’est peut-être le moment d’identifier et d’arrêter les acteurs qui se reposent entièrement sur cette technologie » Au-delà du risque immédiat, Brian Levine pointe également une transformation plus structurelle du cybercrime : « Comme dans l’économie traditionnelle, les attaquants vont se faire licencier. Les rôles spécialisés comme développeurs de malwares, responsables du chiffrement, blanchisseurs d’argent risquent de disparaître, remplacés par des IA capables d’orchestrer l’ensemble de la chaîne. »

Un risque encore sous-estimé

Phil Brunkard, conseiller exécutif chez Info-Tech Research Group UK, partage les constats du rapport d’Anthropic, mais s’inquiète surtout de ce qui échappe encore à la surveillance. Selon lui, de nombreuses activités malveillantes passent probablement inaperçues, et tous les fournisseurs d’IA n’ont pas encore mis en place des contrôles efficaces pour éviter que leurs plateformes ne soient détournées. Même si OpenAI et Anthropic reconnaissent l’usage abusif de leurs outils et tentent de détecter les mauvais acteurs, Brunkard souligne que ces mesures restent réactives. « Le vrai défi est de se déplacer en amont », explique-t-il : si les outils peuvent lancer une attaque complète, il est essentiel de savoir qui s’en sert et dans quel but.

Les experts interrogés reconnaissent que la réponse reste floue. Pour Will Townsend, vice-président chez Moor Insights & Strategy, les solutions défensives devront évoluer au rythme de ces infrastructures offensives automatisées : « Des techniques comme le red teaming automatisé, la prévention des injections de prompts, la validation des entrées ou encore l’intégration poussée du renseignement sur les menaces seront clés. Les contrôles DNS peuvent aussi limiter l’émergence de domaines suspects utilisés comme vecteurs d’attaques. » Son collègue Bill Curtis alerte sur l’évolution du cybercrime : « L’IA permet aux criminels de passer d’attaquants débutants, les script kiddies, à un modèle commercial beaucoup plus évolutif, avec des logiciels de type agentic thugware. » Selon lui, cette menace est aujourd’hui plus urgente que les risques liés à l’informatique quantique. Pour se prémunir, l’analyste recommande une mesure simple mais efficace : déconnecter les systèmes critiques d’Internet, en recourant à des centres de données isolés (air-gapped).