Slopsquatting : les hallucinations des IA se transforment en menace

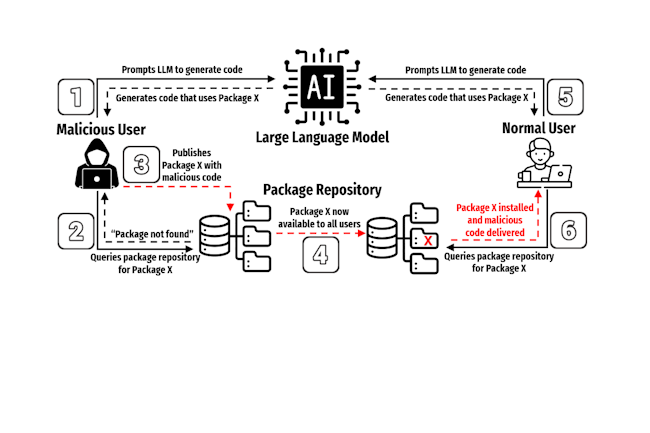

Des chercheurs ont découvert une technique où des attaquants peuvent utiliser et distribuer des paquets recommandés mais surtout inventés par des modèles IA.

La sécurité des modèles d’IA est devenue un sujet important. Plusieurs techniques existent pour faire plier les garde-fous et corrompre les résultats : empoisonnement de données, usage de langage méconnu, …. Une équipe de l’université du Texas à San Antonio, de Virginia Tech et de l’université d’Oklahoma vient d’en trouver une autre qui s’appuie sur la capacité des LLM à halluciner du code. Nommée slopsquatting, elle constitue une menace pour le cycle de…

Il vous reste 90% de l’article à lire

Vous devez posséder un compte pour poursuivre la lecture

Vous avez déjà un compte?